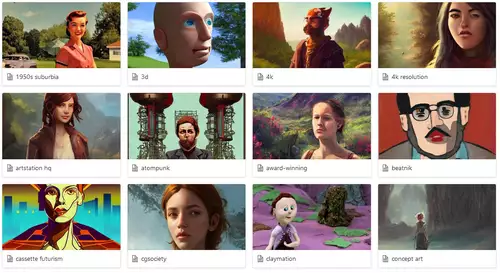

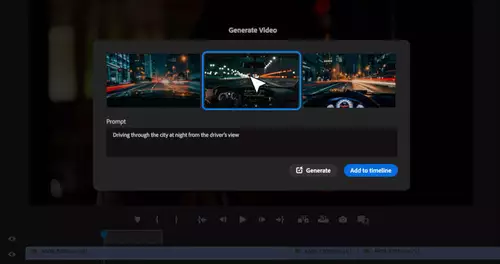

Generative KI-Modelle wie Midjourney, Runway oder Stable Diffusion sind in aller Munde und werden auch immer leichter für jedermann zu bedienen. Dennoch verstehen die wenigsten Anwender auch nur im Ansatz, was hinter den Kulissen vor sich geht.

Ein gewisses Grundverständnis kann sicherlich nicht schaden. Sei es, um nachfolgende Technologien besser einordnen oder auch um beim Prompting strategischer vorgehen zu können. Noch dazu ist es enorm spannend zu begreifen, wie aus einigen ganz primitiven Grundelementen plötzlich die Magie der künstlichen Intelligenz entstehen kann.

Wir versuchen, so weit wie nur möglich auf die zugrundeliegende Mathematik und Statistik als Erklärung zu verzichten, denn dieser Artikel soll wirklich jedem Interessierten vermitteln, was hinter den Türen von Stable Diffusion und Co vor sich geht. Also angeschnallt und los gehts...

Wirklich eine Blackbox?

Die Idee hinter neuronalen Netzen und dem damit verbundenen Deep Learning unterscheidet sich grundsätzlich von dem Ansatz des klassischen Programmierens.

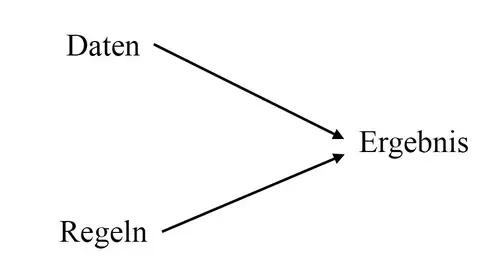

Beim Programmieren versucht man aus Daten und selbst formulierten Regeln ein Ergebnis zu erzielen:

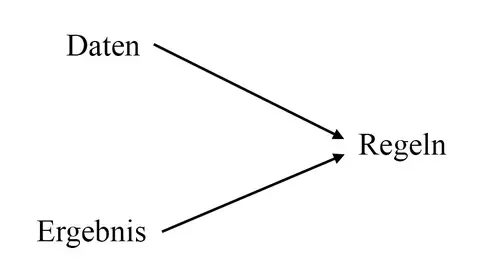

Bei der Künstlichen Intelligenz versucht man dagegen, aus Daten und bekannten Ergebnissen die dahinter liegenden Regeln für einen Zusammenhang zu finden:

Das Faszinierende an den meisten modernen KI-Modellen ist zudem, dass man zum Lernen keinerlei Vorannahmen zu den Daten mehr mitliefern muss. Die Netze erkennen im besten Fall selbständig, was sie aus den Daten lernen sollen. Das klingt erst einmal unglaublich, ist aber tatsächlich der Fall. Doch um die Implikationen daraus grundsätzlich zu verstehen, müssen wir uns jedoch noch tiefer in den Kaninchenbau fallen lassen.